Ferngesteuerte Drohnen sind in Kriegen Alltag. Noch haben Menschen die Kontrolle. Was, wenn sie das Auslösen von Angriffen der Software überlassen?

Rundschau-Debatte des TageUnd wenn die Waffe selbst entscheidet?

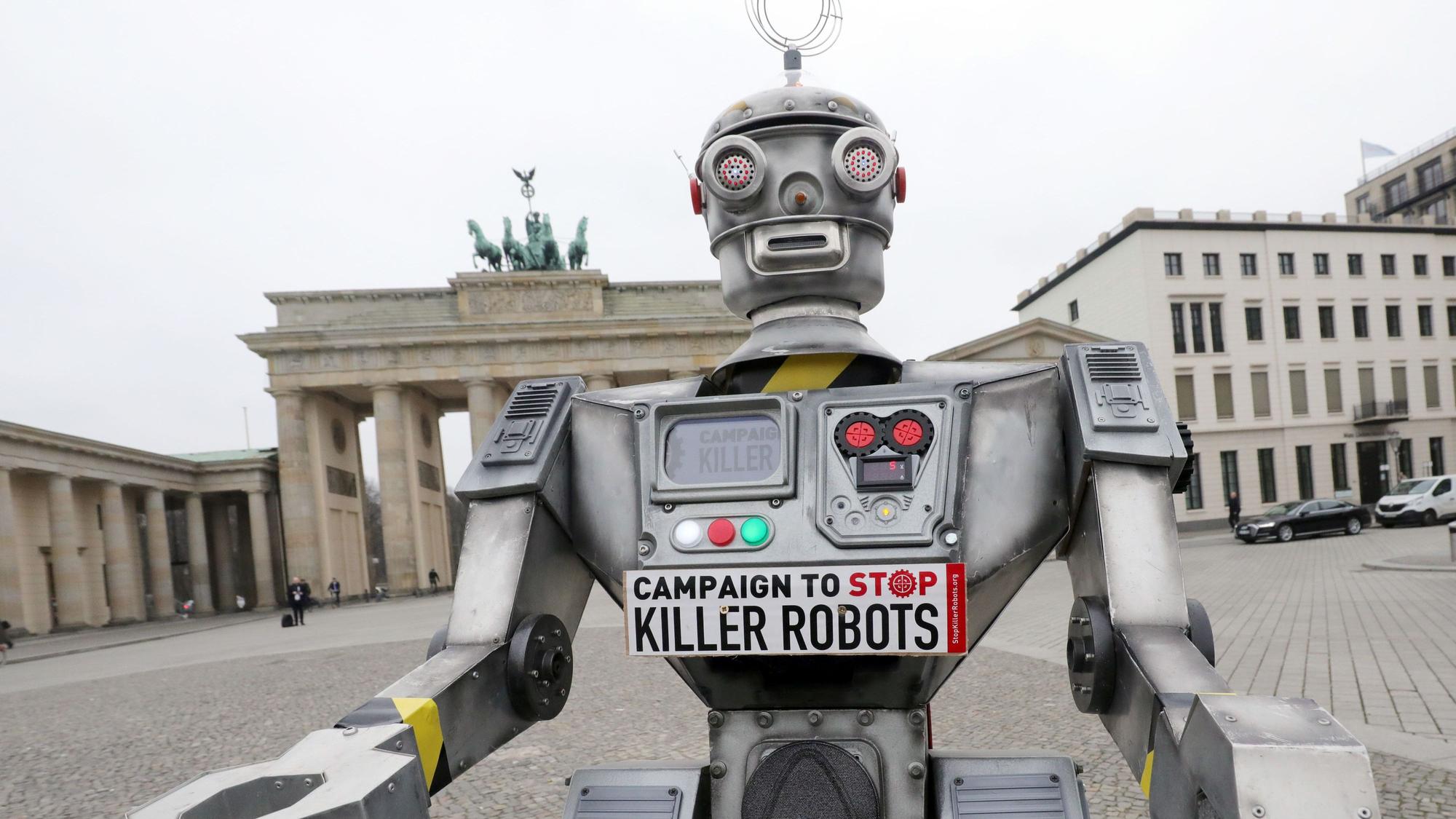

Protest gegen Killerroboter vor dem Brandenburger Tor 2019.

Copyright: picture alliance/dpa

Auch beim Militär hält künstliche Intelligenz Einzug. Was würde passieren, wenn Waffensysteme Ziele nicht nur identifizieren, sondern ihre Software auch ohne menschliches Zutun entscheidet, wo angegriffen wird? Raimund Neuss fragte den Kölner Sozialethiker Elmar Nass.

Angesichts des Ukraine-Krieges wird viel über Rüstungsmessen berichtet. Da kommt man sich vor wie in einer Cyber-Welt. Längst gibt es autonome Autos – sehen Sie auch eine Tendenz zu autonomen Waffen, die den Soldaten Entscheidungen abnehmen? Wo?

Ja, die von Künstlicher Intelligenz geprägten und bestimmten Bereiche werden immer vielfältiger und breiter. Das gilt auch für den Waffengebrauch im Krieg. Moderne Raketenabwehrsysteme auch im Bereich der Bundeswehr etwa operieren schon so. Deren Gebrauch wird vor dem Hintergrund des Rechts und auch ethisch nicht als problematisch angesehen. Anders sieht es bei Waffensystemen aus, welche feindliche Soldaten im Krieg töten sollen. Da geht es nicht nur um die schon im Einsatz befindlichen Drohnen, sondern etwa um Raketensysteme, die nach Aktivierung durch Menschen selbst Ziele auswählen und in diesen „Entscheidungen“ nicht mehr kontrolliert oder gestoppt werden können.

Macht es das Töten im Krieg denn besser, wenn ein Mensch die Entscheidung trifft und keine Maschine?

Die Tötung von Menschen ist immer ein Übel. Denn sie verstößt ganz offensichtlich gegen die Würde dieses Opfers. Wenn die letzte Entscheidung zur Tötung bei einem Algorithmus liegt, senkt dies die Hemmschwelle zu solchen Tötungsakten. Mitgefühl mit den Opfern schwindet. Töten erscheint wie in einer virtuellen Realität. Und wer ist am Ende verantwortlich für Kriegsverbrechen, die ein Algorithmus verursacht hat? Und auch die Operatoren werden ihrer Entscheidungsfreiheit beraubt, verantwortlich einzugreifen, wenn es nötig wäre. Auch sie werden so Instrumente der sich selbst genügenden Algorithmen.

Auch, wo Menschen entscheiden, verlassen sie sich auf Computer. Ein ukrainischer Artillerieoffizier stützt sich etwa auf die Vorschläge seines Tablet-Computers. Ist dieser letzte Schritt, die menschliche Bestätigung, da moralisch noch erheblich?

Bei den voll autonomen Waffen ist diese letzte menschliche Entscheidung ausgeschlossen. Aus meiner Sicht macht genau diese fehlende menschliche Kontrolle einen wesentlichen Unterschied. Einerseits ist das Leben der Opfer dann komplett ein Spielball von Algorithmen. Deren Würde wird also einer eiskalten Berechnung ausgeliefert. Wenn am Ende noch ein Mensch mit entscheidet, so kann er möglicherweise Kriegsverbrechen verhindern. Und, wenn er ethisch geschult ist, dann weiß er immer auch um das Übel der Tötung von Menschen. Und genau das kann im Zweifel eine solche Bestätigung noch verhindern. Algorithmen hingegen haben weder ein Bewusstsein für Schuld noch für Würde und Menschlichkeit.

Könnte Künstliche Intelligenz die Welt auch sicherer machen? Autonome Autos fahren besonders defensiv.

Tatsächlich wird so argumentiert: Dieser Einsatz von Waffen schütze das Leben eigener Soldaten. Ein Algorithmus werde nicht aus Rache oder Hass handeln. Das reduziere die Brutalität. Und man könnte sogar eine Art Moral einprogrammieren. Dadurch soll dann – wie in der Medizin – eine evidenzbasierte moralische Entscheidung im Krieg getroffen werden. Dagegen ist zu sagen: Das Leben der Gegner wird nicht geschont. Der scheinbare moralische Algorithmus operiert ohne Begründung, ohne Werte, ohne Vernunft und Gefühl. Es gibt keine künstliche Moral, denn Moral setzt ein Bewusstsein von Gut und Böse voraus. Kühle Kalkulation kann niemals Menschlichkeit erzeugen.

Sollten wir eine Art Cyber-Rüstungskontrollvertrag anstreben?

Ja, ich würde das begrüßen. Voll autonome Waffen sollten geächtet werden, weil sie die Opfer und auch die Operatoren instrumentalisieren und so den Menschen einem Regiment der Algorithmen ausliefern. Für solche Systeme, die noch ein Eingreifen von Menschen erlauben, sollte es von der UN vorgegebene und standardisierte Schulungen zu Würde, Verantwortung und Tugenden geben. Es muss bei allen Betroffenen ein Bewusstsein geschaffen werden, dass Tötung immer ein Übel ist, und sei es noch so gut begründet. Das hält die Hemmschwelle hoch.

Und wenn so etwas scheitert?

Länder, die sich nicht daran halten, sollten von der Völkergemeinschaft umgehend geächtet werden. Um dann ein Wettrüsten mit moralisch unvertretbaren Waffen zu verhindern, müssten dann sehr schnell sehr wirksame Sanktionen erfolgen.

Das Beispiel Kargu-2

2020 könnte es in Libyen erstmals zum Einsatz einer tödlichen autonomen Waffe gekommen sein. Das legt ein Bericht für den UN-Sicherheitsrat nahe. Eine am 25. Mai 2020 bei Tripolis aufgefundene Einwegdrohne (Loitering Munition) des türkischen Modells Kargu-2, eingesetzt von den Regierungstruppen, soll so programmiert gewesen sein, dass sie auch ohne Funkverbindung zu einer Basisstation einen Rebellenverband jagte. Der Londoner Militärwissenschaftler Jack McDonald äußerte allerdings Zweifel an dieser Darstellung. Die Funkverbindung zur Drohne könnte auch unbeabsichtigt abgebrochen sein. Ob sie tatsächlich autonom agiert habe, lasse sich nicht sagen. (rn)